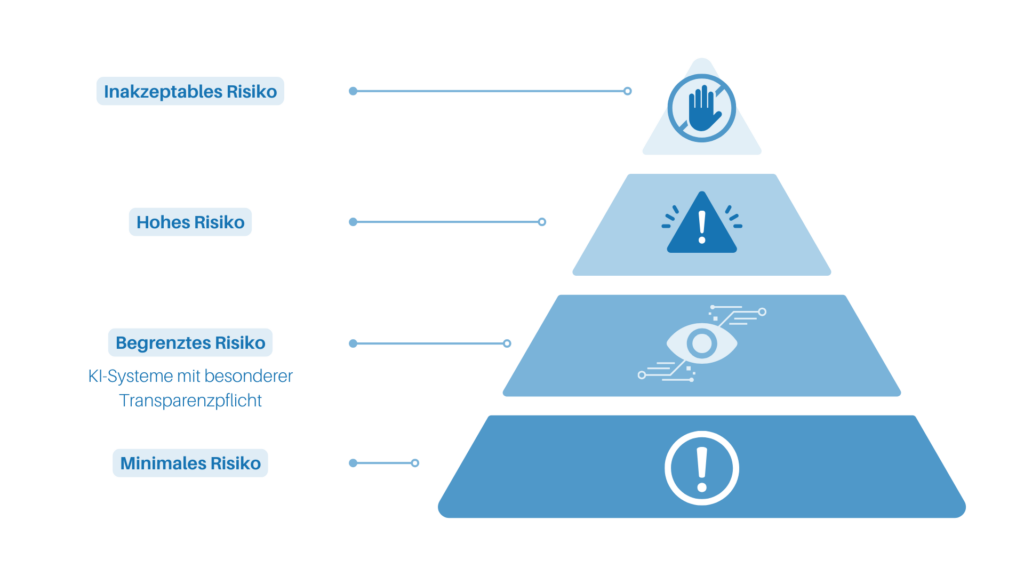

Für die Regulierung von Künstlicher Intelligenz, kurz KI oder im Englischen Artifical Intelligence, kurz AI, hat die EU vor kurzem den European AI Act verabschiedet. Er setzt einen wichtigen, wenn auch verbesserungsfähigen, Rahmen und soll unter anderem dafür sorgen, dass KI nicht für destruktive Zwecke eingesetzt oder missbraucht wird. Der Fokus liegt auf einem „risk-based approach“, der KI in die folgenden vier Risikoebenen einteilt:

Als Rahmenwerk, das regulierend wirken soll, ist der EU AI Act, bei aller berechtigten Kritik ein wichtiger Schritt. Die deutsche Bundesregierung ist dabei, die Regelungen im nationalen Recht umzusetzen.

Wer ihr euch mit dem EU AI Act genauer befassen wollt, empfehle ich euch den Leitfaden von Algorithm Watch als Lektüre.

Ein regulatorischer Rahmen entsteht oder existiert also. Doch dieser adressiert aus meiner Sicht zwei entscheidende Faktoren nicht ausreichend: die ökologischen Kosten und den gesellschaftlichen Nutzen der generativen KI Nutzung.

Verantwortungsvoller KI Einsatz braucht ökologische und soziale Facetten

Microsoft lässt den für den schwersten nuklearen Störfall der USA bekannten Atomreaktor wieder hochfahren und sichert sich den so erzeugten Strom für die nächsten 20 Jahre. OpenAI Chef Sam Altman fordert mehr Kernenergie für den Betrieb der KI-Rechenzentren, und der Wasserverbrauch zur Kühlung der Rechenzentren lässt die Ökobilanz schlecht aussehen.

So faszinierend und nützlich KI allgemein und generative KI speziell auch ist: Sie hat Kosten, die auf den ersten Blick für Nutzerinnen und Nutzer nicht klar sind.

Dazu kommt, dass KI-Werkzeuge auch soziale Probleme verursachen können, da sie alles andere als neutral sind. Der KI-Chatbot zur Berufsorientierung des österreichischen Arbeitsmarktservice, kurz AMS, wurde zwar mehrfach nachgebessert, diskriminiert bei seinen Empfehlungen für berufliche Werdegänge jedoch immer noch. Ein Grund: Er basiert auf ChatGPT, das einige Biases, also systematische Fehleinschätzung, mitbringt.

In den Niederlanden trieben fehlerhafte Kindergeldrückforderungen, erstellt durch ein KI-basiertes System, zahlreiche Menschen in den Ruin. Ob die Niederlande daraus gelernt haben, muss sich erst noch zeigen.

Diese wenigen Beispiele machen deutlich: Neben den ökologischen Kosten müssen auch die sozialen Auswirkungen der KI Nutzung berücksichtigt werden.

Beide Faktoren spielen im European AI Act keine Rolle. Eine Lösung habe ich nicht, jedoch einen Vorschlag für ein Konzept, mit dem wir eine verantwortungsvolle KI Nutzung sicherstellen können. Sie basiert auf einer Idee der Datenschutzgrundverordnung, kurz DSGVO.

Berechtigtes Interesse und realer Nutzen als Kriterien der verantwortungsvollen KI Nutzung

In der DSGVO ist unter anderem das Prinzip des berechtigten Interesses als Grundlage für die Datensammlung und -verarbeitung definiert. Für die Details verweise ich auf die Seite der Europäischen Kommission zu diesem Thema, das Prinzip ist jedoch denkbar einfach:

Jeder, der Daten sammeln und verarbeiten will, muss ein berechtigtes Interesse an der Erhebung und Verarbeitung nachweisen können.

In der Praxis hat die Umsetzung noch einiges Potenzial, Prinzip und Intention finde ich jedoch hervorragend.

Für die verantwortungsvolle KI Nutzung schlage ich daher ein erweitertes Prinzip vor: berechtigtes Interesse und realer Nutzen.

Das Konzept sähe so aus: Die alltäglichen Aufgaben, die KI, hier konkret generative KI, erfüllen kann, müssen auf den Geräten wie Smartphones, Laptops, Computer oder Tablets direkt laufen. Schon heute sind grundlegende Funktionen offline möglich, würden Hersteller dazu verpflichtet, diese Entwicklung zu priorisieren, wäre hier noch einiges mehr möglich.

Wer jedoch KI im größeren Stil nutzen und auf serverbasierte Anwendungen mit großer Kapazität und weiterentwickelten Fähigkeiten zugreifen will, muss diesen Einsatz mit berechtigtem Interesse und realem Nutzen rechtfertigen.

Da serverbasierte KI-Anwendungen ressourcenintensiv sind, muss das Unternehmen oder der Anwender oder die Anwenderin darlegen, warum er oder sie ein berechtigtes Interesse an der Nutzung dieser Ressourcen haben.

In der Praxis wären das natürlich nur bei umfangreichen Anfragen Einzelfallentscheidungen, in den meisten Fällen würden, wie beim berechtigen Interesse in der DSGVO, vordefinierte Anwendungs- und Nutzungsszenarien greifen.

Neben diesem Interesse müsste jedoch auch der reale Nutzen dargelegt werden. Realer Nutzen bedeutet hier: Welchen Vorteil bietet der KI-Einsatz gegenüber nicht KI-basierten Methoden und Vorgehensweisen.

Hier müsste deutlich werden, dass die KI-Nutzung voraussichtlich beispielsweise so viel Zeit oder Ressourcen an anderer Stelle einspart, dass der Ressourcenverbrauch gerechtfertigt ist.

Auch hier würden definierte Szenarien greifen, ab einer gewissen Nutzungsschwelle würde die Anfrage dann von einer Behörde geprüft und im Einzelfall entschieden werden.

Verantwortungsvolle KI Nutzung als Gegenentwurf zum Narrativ der universell verfügbare KI

Mir ist klar, dass dieses Konzept in der praktischen Umsetzung noch viele Fragen und Klärungsbedarf hat. Und ich freue mich darauf, all die Kritikpunkte, Probleme und Schwächen in den Kommentaren zu lesen.

Das meine ich völlig ernst, denn dieser Artikel verfolgt zwei Ziele:

- Das Konzept und die Idee öffentlich machen und zur Diskussion anregen. Durch die kritisch-konstruktive Diskussion können dann entweder eine bessere Version oder völlig andere Ansätze entstehen.

- Eine weitere Alternative zum Narrativ der „Big Tech“, der universellen Verfügbarkeit von Ressourcen und der Ressourcen-Agnostik.

Dieses zweite Ziel habe ich vor einiger Zeit bereits im Podcast und hier im Blog begonnen.

Ich zitiere mich ausnahmsweise mal selbst:

Das aktuell gängige – und leider fast schon akzeptierte – Narrativ ist, dass generative KI in den nächsten Jahren in allen Bereichen unseres Alltags Fuß fassen und unsere Arbeit und unser Leben spürbar verändern wird. Dieses Narrativ ist jedoch kein Naturgesetz und kein Automatismus, sondern lediglich die Zukunftsvorstellung, die Big Tech-Unternehmen – natürlich nicht uneigennützig – verbreiten und pushen.

Wir können und sollten dieses Narrativ kritisch hinterfragen und unser eigenes entwickeln. Was spricht dagegen, generative KI nur nach einer Kosten-Nutzen-Abwägung zugänglich zu machen? Warum kann eine transparente Entwicklung – vielleicht sogar nach Open-Source-Prinzipien – nicht verpflichtend werden?

Das Prinzip des berechtigten Interesses und realen Nutzens ist ein weiterer Baustein für ein anderes Narrativ, in dem wir KI nicht einfach als Gegenstand hinnehmen, sondern bewusst hinterfragen, ob ihr Einsatz berechtigt und nützlich ist.

Jetzt bin ich gespannt: Was sagt ihr zum Konzept? Lasst mich eure Meinung, Kritik und Alternativen in den Kommentaren wissen, ich freue mich auf den Austausch.

Schreibe einen Kommentar